在过去的几年里,我将主要精力放在研究情商算法上,因为这是我的创业公司Inbot的主要业务。然而对它们的研究越多,我就越确信,人类相对于AI的情商优势正在缩小。

他们的论述都是有道理的。我们的情感和感觉是对环境做出反应的有机算法。算法是由我们的文化历史、教育和生活经历塑造的,它们可以被逆向推导。

如果我们同意赫拉利博士和泰格马克博士的观点,意味着我们相信计算机最终会比人类自己更擅长操纵人类的情感。在现实生活中,人类实际上非常不善于处理与情商有关的东西。

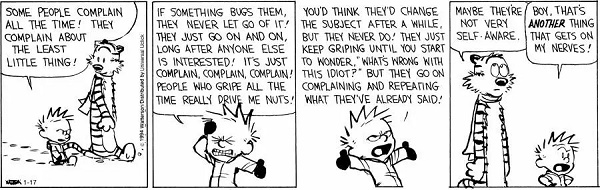

我们大多数人都对自己在别人身上触发的最基本情感一无所知。我们通常都以毫无疑义的争吵结束交流,并摒弃了更好的理由,因为它们违背了我们的偏见,即基于刻板的印象来评判别人。

我们不理解文化背景、家庭教育的影响,亦或是我们讨论伴侣当前个人生活状况的影响。我们很少试图站在别人的立场上以不同的角度看待问题。如果违背我们的世界观,我们就不会尝试去理解他们的理由。我们不想挑战我们的偏见或成见。

当我们人类继续努力相互理解时,高情商的AI已经获得速发展。手机摄像头无处不在,面部追踪软件已经足够先进,可以分析我们面部表情中最微小的细节。最先进的面部追踪软件甚至能分辨出虚假的情感。

语音识别和自然语言处理算法也能更好地从音频中识别出我们的情绪和情绪状态。分析人脸和声音情绪反应的技术已经远远超出了一般人的能力,而且在许多领域甚至超过了最有能力的人。AI可以通过观察我们的面部识别出你的性取向、政治倾向或智商等个人特质。

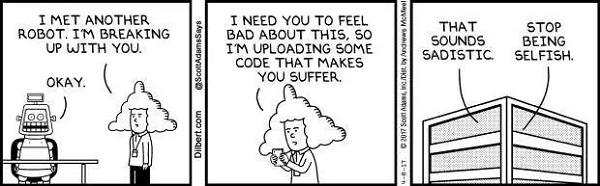

虽然AI可以从你的面部或语音中识别出几乎任何情绪,但我们在对情商AI的科学研究上还没有投入太多精力。

目前,这一领域的进步几乎完全是由商业利益和人类贪婪所驱动的。

媒体和娱乐公司需要我们的关注和参与才能赚钱。像Facebook和YouTube这样的公司有大量的工程师在努力创造更好的方法,以便让我们沉迷于他们的内容。我在之前的一篇文章中提到过这个问题,名为《上瘾行业令人担忧的增长》。

算法的进步如此之大,以至于Facebook和谷歌现在被指制造出可以影响公众意见、迅速改变政治格局、影响选举的过滤泡沫。这些算法变得如此复杂,以至于人类无法完全控制它们。Facebook的安全主管亚历克斯·斯塔莫(Alex Stamos)最近在推特上说,记者们批评他们存在操作行为非常不公平。事实上,他们没有任何不会导致人们指责他们有偏见的解决方案。

人们有很多偏见,这已经影响了我们的判断。我们看到的世界是我们所希望看到的,而不是它的本来面目。如今,由人类开发的算法也包含了许多人类特有的偏见。但如果我们想要消除这种偏见,那就相对容易了。

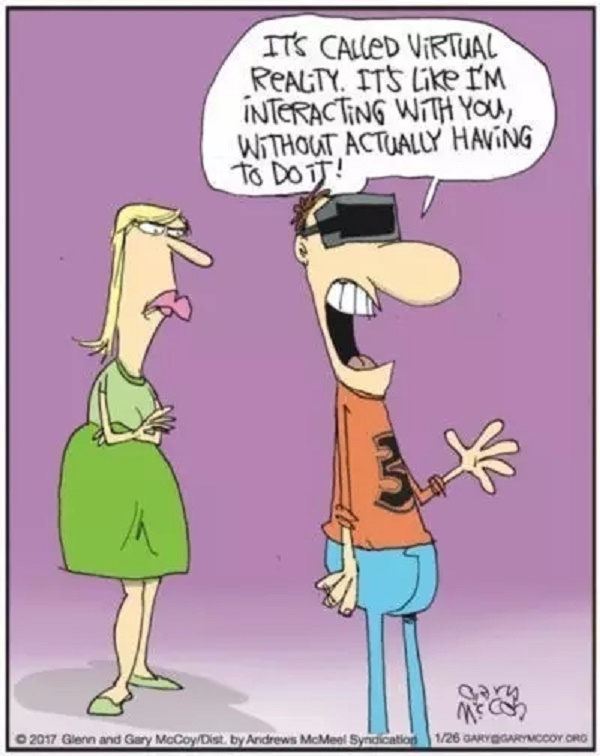

随着AI越来越擅长操控我们,我发现人们乐于将自己的生活交给未来算法来管理。我们已经在实践中看到这种情况。只要在公共场合环顾四周,你会发现几乎每个人都被他们的智能手机所吸引。人们每天平均触摸手机2617次,这是一个预示着未来科技将会快速发展的指示器。我们可能很快就会看到,人类与AI的角色可能发生转换,AI利用人类作为有机机器人来实现其目标。